1. イントロダクション:AI開発は「ノリ」から「規律」の時代へ

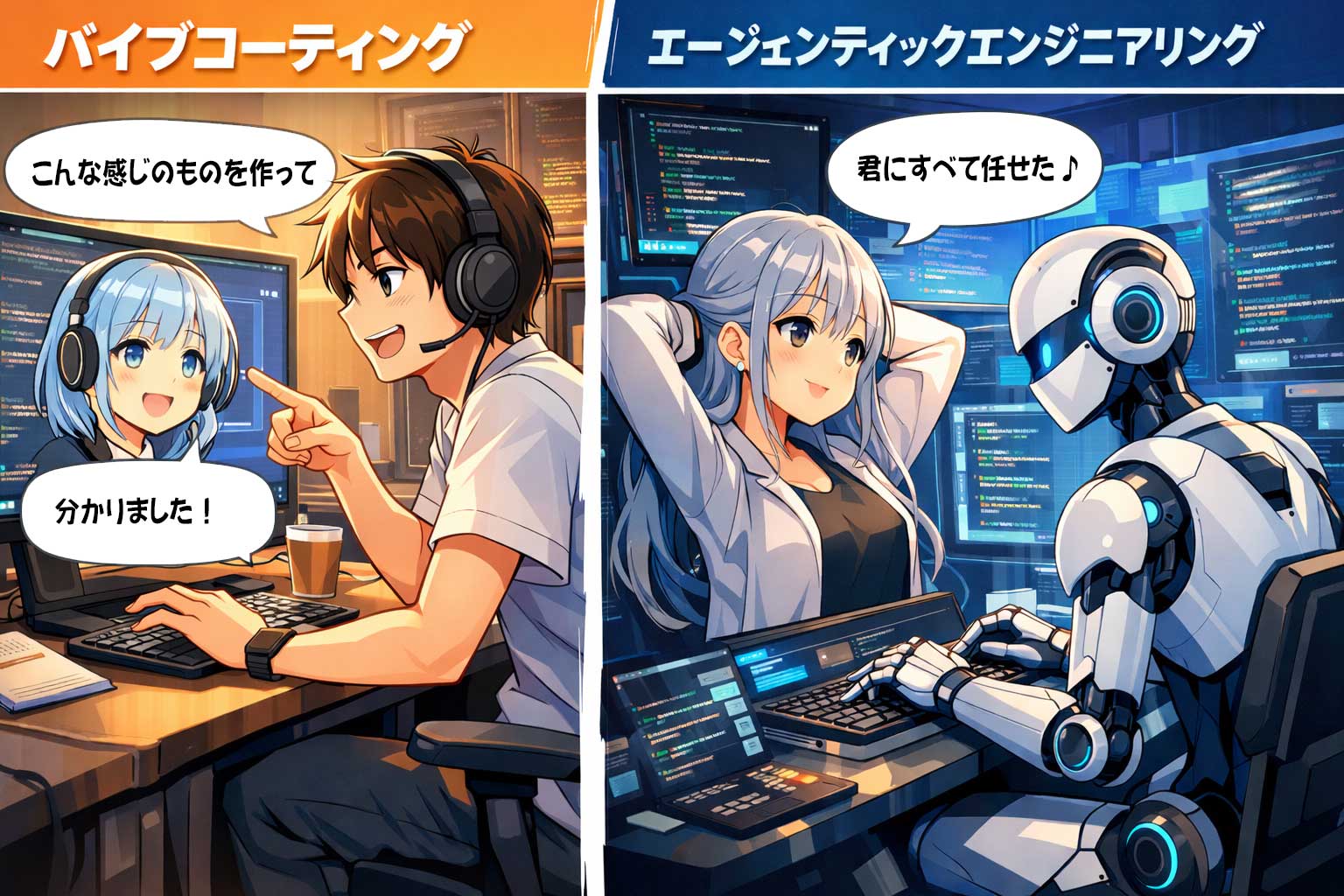

今までも何回かブログにも書きましたが2025年、「Vibe Coding(バイブ・コーディング)」という流れが加速しました。AIに対し、自然言語で依頼し、直感と「ノリ(Vibe)」でコードを生成させるこの手法は、開発の劇的な高速化をもたらしました。しかし、その「ノリ(Vibe)」で書かれたコードが企業にとって厄介なことになることもあります。

つまり検証なしにAI生成コードを積み上げた結果、企業の中には生成AIが作ったアプリを保守ができない状態と、修正のたびに新たなバグが生まれることに直面するケースが出てきています。こうした中、元TeslaのAIディレクター、Andrej Karpathy氏が提唱する「Agentic Engineering(エージェンティック・エンジニアリング)」へのパラダイムシフトが、2026年の企業経営における新標準として急浮上しました。

今回は、経営層やマネージャー層に向け、AIを単なる「直感的なツール」からの脱却と、生産性とガバナンスを両立するための戦略的指針を書いてみたいと思います。

2. バイブ・コーディングの功罪と「見えない負債」

「雰囲気」で動かすスタイルの限界

バイブコーディングとは、Karpathy氏の言葉を借りれば「See stuff, say stuff, run stuff(見て、言って、実行する)」という、直感重視の開発スタイルです。詳細な仕様書を書く代わりに、AIが出力したコードを深い検証なしに「Accept All(全承認)」し、エラーが出ればエラーログをそのままAIに貼り付けて修正を繰り返す。これは非エンジニアにとっては最適でしたが、リスクをあまり考えないものでもありました。

露呈したリスク:フローと負債のトレードオフ

現在、企業の中には「開発を急ぐか、将来のコストを抑えるか」という難しい選択に頭を抱えています。

- システムがどんどん複雑になっていく問題: AIは目の前の作業だけを片付けようとするため、全体のバランスを考えません。その結果、建物で言えば「増改築を繰り返した結果、どこに何があるかわからない迷宮」のようなシステムが出来上がり、誰も読み解けないプログラムが雪だるま式に増えていきます。

- 「直しても直しても壊れ続ける」罠: システムが複雑になるほど、AIは全体像を把握しきれなくなります。すると、1つの不具合を直すようにAIに頼むたびに、別の場所で2つの新しい不具合が生まれるという悪循環に陥ります。最終的には「もう手が付けられない」という状態になり、開発が完全に行き詰まります。

- セキュリティがスカスカになる問題: AIは「とにかく動けばいい」という発想でプログラムを作るため、セキュリティへの配慮が後回しになりがちです。その結果、外部から個人情報を盗み取られる穴や、鍵をドアの前に置いておくような杜撰な管理が、最初から組み込まれたシステムが出来上がってしまいます。

3. Agentic Engineering(エージェンティック・エンジニアリング)への進化

バイブコーディングの「ノリでコーディング」のフェーズを終え、いよいよ「仕事」としてAIを使い倒すフェーズが「Agentic Engineering」の時代になりそうです。

AIの「考え方」が、直感型から熟考型へと進化しています。

これまでのAIは、質問に対してすぐに答えを返す「直感型」でした。ちょうど人間が「1+1は?」と聞かれて考えるまでもなく「2」と答えるような感覚です。

しかし2026年の主要なAI(GLM-5、Claude Opus 4.5、GPT-5.1-Codex-Maxなど)は、「熟考型」へと移行しています。難しい問題に直面したとき、即座に答えを出すのではなく、「まず計画を立て、実際にやってみて、結果を確認する」というプロセスを何度も繰り返すようになりました。

これを支えているのが「Test-time compute scaling」という仕組みです。難しい問題ほど、AIが「頭の中で考える時間と処理能力」を自動的に増やす、というイメージです。人間で言えば、簡単な計算はすぐ暗算で済ませるけれど、難しい問題にはじっくり時間をかけて紙に書きながら考える、そのメリハリをAI自身がつけられるようになった、ということです。

循環型ループ(Cyclic Loop)の確立

エージェンティック・エンジニアリングでは、以下の4ステップによる「循環型ループ」を回します。

| ステップ | 内容 | 役割 |

| Explore(調査) | コードベース全体を走査し、システム構造を理解する。 | リサーチャー |

| Plan(計画) | 実装の前にタスクリストを作成し、人間がレビューする。 | プランナー |

| Implement(実装) | 計画に基づき、サンドボックス環境でコードを記述する。 | コーダー |

| Verify(検証) | テストを実行し、エラーがあれば自律的に自己修復する。 | テスター |

AIに仕事をさせるとき、「チームで分担させるか、一人にまかせるか」という議論が続いています。

「スワーム(群れ)」とは、それぞれ専門分野を持つ複数のAIが、人間のチームのように役割分担しながら協力して作業を進める方式です。

一方「シングルスレッド」とは、一人の優秀な担当者がすべての作業を最初から最後まで一貫して引き受ける方式です。

AI業界でもこの選択について意見が分かれています。Anthropicは「複数のAIを連携させるほうが効果的」と主張する一方、AIツール「Devin」を作ったCognition AIは「複数のAIに仕事を分けると、お互いの情報共有がうまくいかず、かえって失敗しやすい。1つのAIに一貫してやらせたほうが安定する」と主張しています。

どちらが正解かは一概には言えず、取り組む仕事の複雑さによって使い分けを判断する必要があります。シンプルなプロジェクトなら一人に任せたほうが安全で、複雑な大型プロジェクトならチーム制が力を発揮する、というイメージです。

4. 経営的メリット:生産性100倍とは?

圧倒的な生産性の向上

富士通が開発したAIを活用した開発プラットフォームの事例が、その威力を示しています。これまで熟練した担当者が3ヶ月かけて行っていた「古いシステムの解読と修正」という作業が、わずか4時間で完了しました。単純計算で100倍以上の効率化です。さらに注目すべきは、AIが住民票や税務といった「専門家でも読み解くのが難しい法律の文書」を正しく理解した上で、要件の整理から動作確認まで、一連の作業をすべてやり遂げた点です。

「外注頼り」から「自社で作れる会社」へ

開発作業がAIによって自動化されていくことで、これまでの「人をたくさん集めて時間をかけて作る」というビジネスモデルは通用しなくなっていきます。

代わりに求められるのは、市場の変化に合わせて自社のシステムやサービスを素早く・低コストで作り替えられる「身軽な会社」です。これを「キネティック・エンタープライズ(動的企業)」と呼びます。

2026年以降、「変化に素早く対応できる自前の開発力を持つ会社」と「外注に頼り続ける会社」の間には、埋めがたい競争力の差が生まれることになります。

5. 潜むリスクと経営者が講じるべき安全策

自律性が高まる一方で、経営者が注視すべき新たなリスクも顕在化しています。

コストと規律:PRM(プロセス報酬モデル)の導入

エージェントがエラー解決のために無限ループに陥り、数時間で数千ドルのAPIコストを消費する「コスト暴走」が多発しています。これに対し、2026年のベストプラクティスは「結果」だけでなく「プロセス」を評価するPRMの導入です。

| 評価モデル | 特徴 | 経営的利点 |

| ORM (Outcome Reward Model) | 最終回答のみを評価する。 | 実装が容易だが、途中の誤りに気づけない。 |

| PRM (Process Reward Model) | 推論の各ステップを評価する。 | 途中で軌道修正が可能。コスト暴走を抑制。 |

セキュリティの死角:Slopsquatting

AIがハルシネーション(幻覚)によって存在しないパッケージを推奨する傾向を悪用した「Slopsquatting(スロップスクワッティング)」という攻撃が登場しています。攻撃者はAIが生成しそうな架空の名前でマルウェアを公開し、無防備なエージェントがそれをインストールするのを待ち構えています。

ジュニア・ギャップ(スキルの空洞化)

2024年時点で、CS(コンピュータサイエンス)専攻の失業率は6.1%に達し、哲学専攻の3.2%を大きく上回るという逆転現象が起きています。若手エンジニアがAIに頼り切り、デバッグを通じた「マッスルメモリー(技術的直感)」を失うリスクに対し、企業はあえてAIを使わない訓練期間を設けるなど、教育体制の再構築が求められています。

6. 経営者への提言:自社で取り組むべき3つのアクション

① AIが暴走しないための「歯止め」を仕組みとして作る

AIに自律的に仕事をさせる際は、必ず以下の安全策を組み込んでください。

- AIに与える権限を必要最小限にする: AIが使えるツールやシステムへのアクセスを、業務に必要なものだけに厳しく絞り込む。

- 重要な判断には必ず人間が関わる: お金の動きや重要なデータの操作など、取り返しのつかない作業はAIだけに任せず、必ず人間が確認・承認するステップを設ける。

- AIがいつでも止められる状態を保つ: 人間が「やめろ」「方針を変えろ」と言ったとき、AIが素直に従うよう設計する。

② AIに「何をどう伝えるか」を会社の重要なスキルと位置づける

AIの出力の質は、AIへの指示や情報の与え方で大きく変わります。「次の作業に必要な情報だけを、過不足なくAIに渡す」技術を、今後の自社の競争力の核と捉えてください。AIが参照する社内資料やデータの質を高めることが、そのままAIの仕事の質に直結します。

7. 結論:AIを「魔法の杖」から「数十人の部下」へ

エンジニアの仕事は、もはや「自分でコードを書く人」ではありません。複数のAIに指示を出し、全体をうまくまとめる「指揮者」、あるいは「数十人の部下を持つ管理職」へと役割が完全に変わりました。

現時点では、AIにすべてを任せられるほどの精度はまだありません。しかしだからこそ、「なんとなくAIに任せてみる」という感覚任せのやり方を捨て、きちんとした設計と、結果を必ず確認・検証する仕組みを持つことが、2026年以降に成長するための絶対条件となります。

AIを「よくわからないけど便利な魔法」として使うのではなく、「管理された道具」として規律を持って扱う。その経営判断ができるかどうかが、2026年以降とても重要になっていくと感じています。

コメント